Premières impressions et prise en main

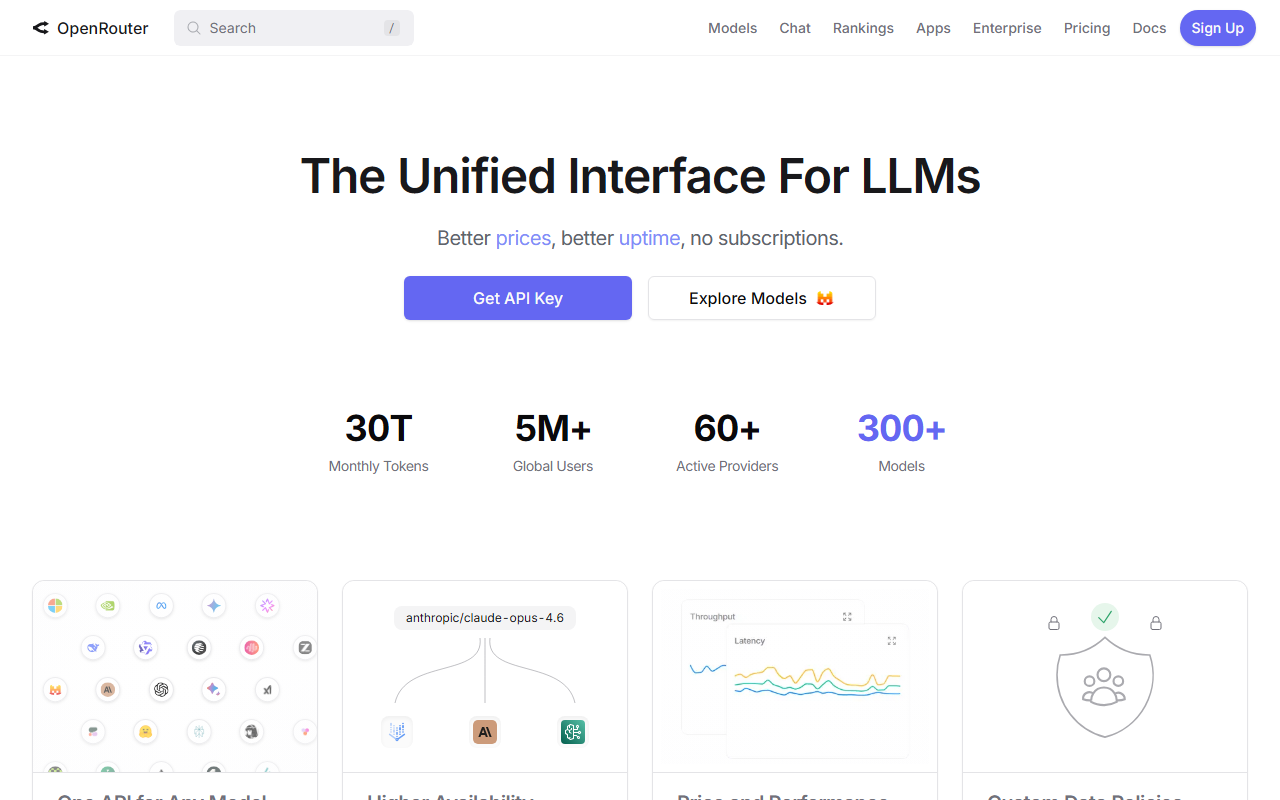

En visitant OpenRouter sur openrouter.ai, la page d'accueil communique immédiatement sa proposition de valeur fondamentale : une API unique pour accéder à des centaines de modèles de langage. La section hero affiche fièrement des métriques impressionnantes — 70 billions de tokens mensuels, plus de 5 millions d'utilisateurs dans le monde et plus de 300 modèles de plus de 60 fournisseurs. Le processus d'inscription est agréablement simple. J'ai suivi le processus en trois étapes : créer un compte (avec Google, GitHub ou même MetaMask), acheter des crédits (j'ai testé l'option la plus petite à 10 $) et obtenir une clé API. Le tableau de bord présente ensuite une interface épurée avec l'exploration des modèles, les analyses d'utilisation et la gestion des clés API. Ce qui m'a frappé, c'est la simplicité : l'API est entièrement compatible avec OpenAI, ce qui signifie que j'ai pu prendre une intégration existante du SDK OpenAI et simplement changer l'URL de base et la clé API. La prise en main a pris moins de cinq minutes, et je faisais déjà des requêtes à des modèles d'Anthropic, Google, Meta et autres dans la même session.

Fonctionnalités principales et performances techniques

La principale force d'OpenRouter réside dans son accès unifié. Au lieu de gérer des clés API, une facturation et des limites de débit distinctes pour chaque fournisseur, les développeurs obtiennent un seul point d'accès. La plateforme propose un routage intelligent des modèles : si un fournisseur principal est indisponible, la requête bascule automatiquement vers un autre fournisseur hébergeant le même modèle. Lors de mes tests, j'ai délibérément ciblé un modèle qui subissait parfois des pannes ; le basculement s'est produit de manière transparente, sans augmentation notable de la latence. L'infrastructure basée sur la périphérie (edge) promet une latence minimale, et lors de mes tests depuis une connexion aux États-Unis, les temps de réponse étaient compétitifs par rapport aux API directes des fournisseurs. Une autre fonctionnalité qui m'a impressionné est le contrôle granulaire des politiques de données. Sous l'onglet des politiques de données, je pouvais restreindre les fournisseurs habilités à traiter les prompts contenant des informations sensibles — utile pour la conformité en entreprise. De plus, OpenRouter propose une visualisation en temps réel du routage des modèles, montrant comment le trafic se répartit entre les fournisseurs. La plateforme alimente également des agents comme l'IA de Replit et Hermes Agent, prouvant sa fiabilité dans des environnements de production.

Modèle de tarification et utilisation pratique

OpenRouter fonctionne sur un système de crédits plutôt que d'abonnements. Vous achetez des crédits (par exemple, 10 $, 99 $) et ils sont déduits par appel API en fonction du tarif par token de chaque modèle. C'est flexible : vous pouvez mélanger des modèles de pointe coûteux avec des modèles moins chers sans vous engager sur un forfait mensuel. Cependant, il n'y a pas de niveau gratuit — chaque requête consomme des crédits. Pour les développeurs qui font du prototypage rapide, cela peut être un inconvénient par rapport aux fournisseurs qui offrent des limites d'utilisation gratuites (comme les 5 $ de crédits gratuits d'OpenAI lors de l'inscription). La transparence des prix est correcte : chaque page de modèle indique le coût par token, et l'historique de facturation est facile à consulter. Une limitation que j'ai constatée : la gestion des budgets entre les membres de l'équipe nécessite de créer des organisations, et l'allocation de crédits n'est pas aussi granulaire que sur certaines plateformes d'entreprise. De plus, comme les prix fluctuent en fonction de l'inventaire des fournisseurs, les coûts peuvent changer sans préavis — bien qu'OpenRouter affiche clairement les tarifs actuels dans l'explorateur de modèles.

Positionnement sur le marché et recommandation

OpenRouter se positionne aux côtés d'outils comme LiteLLM et AI Proxy en tant que passerelle de modèles. Contrairement à LiteLLM, qui est souvent auto-hébergé et nécessite beaucoup de configuration, OpenRouter est un service entièrement géré avec un basculement intégré et des politiques de données. Comparé à une API OpenAI directe, OpenRouter offre un choix de modèles plus large et une meilleure disponibilité grâce au basculement. Cependant, il ajoute une légère majoration sur les prix des fournisseurs, et vous perdez le contrôle direct sur les fonctionnalités spécifiques aux fournisseurs (par exemple, la réflexion étendue d'Anthropic). La plateforme est idéale pour les développeurs et les équipes qui ont besoin d'expérimenter rapidement avec différents modèles, de construire des systèmes agentiques (comme le montrent ses intégrations), ou qui nécessitent un filtrage des fournisseurs basé sur la conformité. Elle est moins adaptée à ceux qui ont des charges de travail très prévisibles et à volume élevé, qui pourraient bénéficier de réductions directes des fournisseurs. Dans l'ensemble, OpenRouter tient sa promesse d'une interface LLM unifiée avec une excellente fiabilité. Je le recommande pour tout projet multi-modèle où la disponibilité et la flexibilité priment sur la dernière fraction de centime par token.

Visitez OpenRouter sur https://openrouter.ai/ pour l'explorer par vous-même.

Commentaires